Google DeepMind Revela a Chave para Imagens e Vídeos de IA INCRÍVEIS e Super Rápidos!

Olá, pessoal! Aqui é o Lucas Tech, e hoje a gente vai mergulhar em uma notícia que vai fazer seus olhos brilharem e a sua mente explodir! Sabe aquela história de inteligência artificial gerando imagens e vídeos que parecem reais? Pois é, essa tecnologia está em alta, mas sempre rola um dilema: ou a gente tem uma criação de tirar o fôlego, mas que demora horrores para ser feita, ou algo rápido, mas que acaba pecando na qualidade. Era tipo escolher entre velocidade e perfeição… até AGORA!

A galera GÊNIO do Google DeepMind veio com uma solução que promete mudar tudo: os Latents Unificados (UL). Pensa em imagens e vídeos com qualidade de cair o queixo, produzidos de um jeito muito mais eficiente e em menos tempo! Vem comigo entender essa revolução que já está redefinindo o futuro da IA generativa!

O Dilema da IA Generativa: Qualidade vs. Eficiência (e o papel dos LDMs)

Pra entender a sacada da Google DeepMind, a gente precisa falar um pouquinho de como a IA Generativa, aquela que cria imagens e vídeos do zero, funciona hoje. Grande parte dela usa os Modelos de Difusão Latente (LDMs). Pensa neles como um super compressor de arquivos. Em vez de trabalhar com imagens gigantes e pesadas em sua forma original, eles as transformam em uma versão "miniatura" e mais leve, um espaço latente. Isso ajuda demais a economizar poder de processamento e a escalar o trabalho, sabe?

Mas aí vinha o problema: se você comprimia muito (baixa densidade de informação), ficava mais fácil pro modelo aprender, mas a imagem final podia perder uns detalhes importantes ou a qualidade não era das melhores. Se comprimia menos (alta densidade), a qualidade era top, mas aí exigia um poder de fogo computacional absurdo! Era uma balança chata, até que… a Google DeepMind entrou em campo com os Latents Unificados (UL), um framework que promete resolver esse nó!

Unified Latents (UL): A Magia por Trás da Inovação

Então, o que esses gênios fizeram? Eles criaram um sistema, o UL, que não te obriga mais a escolher entre qualidade e eficiência. Basicamente, o UL é um framework que trabalha regulando as representações latentes (aquelas "miniaturas" da imagem ou vídeo que falamos) com algo que eles chamam de "diffusion prior" (pense como um guia inteligente) e depois decodifica tudo através de um modelo de difusão. A grande sacada é que ele consegue manter a essência da informação de um jeito super compacto, mas sem sacrificar a qualidade na hora de "expandir" de novo, gerando a imagem ou vídeo final. É como ter o melhor dos dois mundos!

Os Três Pilares dos Latents Unificados: A Arquitetura em Detalhes

Pra que essa mágica de otimizar o custo computacional e manter a qualidade aconteça, o framework UL se apoia em três pilares técnicos super inteligentes. Vamos descomplicar:

Codificação com Ruído Gaussiano Fixo

Normalmente, modelos como os Variational Autoencoders (VAEs) aprendem a "codificar" a informação de um jeito meio flexível. O UL é mais direto: ele usa um codificador determinístico (E𝝷) que prevê um único "latente limpo" (zclean). Mas a sacada é que esse latente é então "ruidado" para frente até atingir uma relação sinal-ruído logarítmica (log-SNR) de λ(0)=5. Isso garante que a informação mais importante seja sempre bem representada, sem exageros ou faltas, e de forma controlada.

Alinhamento de Prior (Prior-Alignment)

O modelo de difusão que serve de "prior" (o guia inteligente, lembra?) é alinhado com esse nível mínimo de ruído. Essa sincronia permite que um termo complexo em matemática (o termo Kullback-Leibler – KL) se reduza a um simples Erro Quadrático Médio (MSE) ponderado sobre os níveis de ruído. Em outras palavras, isso simplifica e torna os cálculos muito mais eficientes, como se o sistema soubesse exatamente onde a informação relevante está, sem precisar "procurar" tanto.

ELBO do Decodificador Ponderado (Reweighted Decoder ELBO)

Aqui entra uma perda de peso especial no decodificador, a "sigmoid-weighted loss". Ela é crucial porque oferece um limite interpretável para a taxa de bits latente e, ao mesmo tempo, permite que o modelo priorize diferentes níveis de ruído. Isso significa que ele sabe o que é mais importante e onde focar, garantindo que o resultado final seja de altíssima qualidade, mesmo com a compressão inteligente.

O Treinamento em Duas Etapas: Como a UL Atinge a Perfeição

Pra extrair o máximo do UL, o pessoal da DeepMind bolou um processo de treinamento em duas fases distintas, otimizando tanto o aprendizado do latente quanto a qualidade da geração. Pensa em como um atleta treina: primeiro, ele foca na técnica base, depois, escala pra ganhar força e desempenho.

Etapa 1: Aprendizagem Conjunta do Latente

Nessa primeira fase, o codificador, o "prior" de difusão (P𝝷) e o decodificador de difusão (D𝝷) são treinados juntos. O objetivo é que eles aprendam a trabalhar em sincronia, garantindo que os latentes sejam simultaneamente codificados, regulados e modelados. É a base de tudo, onde a informação é organizada da melhor forma possível, e o ruído do codificador é diretamente ligado ao nível mínimo de ruído do prior, estabelecendo um limite superior preciso para a taxa de bits latente.

Etapa 2: Escalonamento do Modelo Base

Depois que a base está sólida, eles "congelam" o codificador e o decodificador. Aí, um novo "modelo base" é treinado usando esses latentes, mas com uma ponderação especial (aquela sigmoid weighting). Essa etapa é crucial porque melhora DEMAIS a qualidade das amostras geradas, permitindo que o modelo aprenda nuances mais finas e produza resultados ainda mais impressionantes. E o legal é que essa fase permite usar modelos maiores e lotes de dados maiores, o que significa ainda mais poder e qualidade!

Resultados que Quebram Recordes: A UL na Prática!

E o que tudo isso significa na prática? Significa que os Latents Unificados não são só teoria; eles entregam resultados INCRÍVEIS, mostrando uma eficiência absurda entre o quanto de processamento eles usam (FLOPs) e a qualidade final do que geram. Olha só os números que a Google DeepMind conseguiu:

| Métrica | Dataset | Resultado | Significado |

|---|---|---|---|

| FID | ImageNet-512 | 1.4 | Supera modelos treinados em latentes do Stable Diffusion para um dado orçamento computacional. |

| FVD | Kinetics-600 | 1.3 | Estabelece um novo Estado da Arte (SOTA) para a geração de vídeo! |

| PSNR | ImageNet-512 | Até 30.1 | Mantém alta fidelidade de reconstrução mesmo em níveis de compressão mais elevados. |

Isso é sensacional! O FID de 1.4 no ImageNet-512 significa que a UL superou modelos que usam os latentes do Stable Diffusion em termos de qualidade de imagem para o mesmo custo computacional. É como ter um carro esportivo que gasta menos gasolina!

Mas a cereja do bolo é o FVD de 1.3 no Kinetics-600. Aqui a coisa fica séria! A UL simplesmente estabeleceu um Novo Recorde Mundial (State-of-the-Art – SOTA) na geração de vídeo! Imagina vídeos gerados por IA com uma fluidez e realismo nunca vistos, e isso com um custo de treinamento menor!

Em testes, o UL deixou pra trás outras abordagens famosas como DiT e EDM2 em relação ao custo de treinamento vs. a qualidade (FID). E nos vídeos, até uma versão "pequena" do UL já mandou bem, mas a versão "média" alcançou o SOTA de 1.3 FVD. É pra aplaudir de pé!

O que Aprendemos: Os Pontos Chave dos Latents Unificados

Pra não esquecer de nada, aqui estão os pontos mais importantes dessa super novidade da Google DeepMind:

- Um Framework de Difusão Totalmente Integrado: O UL não é só uma peça, mas um sistema completo que otimiza conjuntamente o codificador, o prior de difusão e o decodificador. Isso garante que as representações latentes sejam simultaneamente codificadas, reguladas e modeladas para uma geração de alta eficiência.

- Limite de Informação de Ruído Fixo: Usando um codificador determinístico que adiciona um ruído gaussiano fixo (especificamente com um log-SNR de λ(0)=5) e ligando isso ao nível mínimo de ruído do prior, o modelo consegue ter um controle preciso sobre a quantidade de informação nos latentes, otimizando a qualidade sem desperdício e oferecendo um limite interpretável.

- Estratégia de Treinamento em Duas Fases: O processo em duas etapas, primeiro aprendendo junto (codificador, prior, decodificador) e depois escalando o modelo base separadamente, é o segredo para maximizar a qualidade das amostras geradas, superando limitações de treinamento de modelos anteriores.

- Desempenho de Ponta: A UL não é só promessa; ela entrega! Novos recordes em FVD (1.3 no Kinetics-600 para geração de vídeo) e um FID super competitivo (1.4 no ImageNet-512 para geração de imagem), exigindo menos poder de computação (FLOPs) do que os modelos de difusão latente tradicionais. Isso é ouro para o futuro da IA generativa!

Minha Visão

Gente, isso aqui não é só mais um avanço técnico; é uma virada de jogo! Como um entusiasta de tecnologia, eu vejo os Latents Unificados da Google DeepMind como um divisor de águas. Acabar com o dilema entre qualidade e eficiência significa que criar imagens e vídeos incríveis com IA vai se tornar muito mais acessível, rápido e realista.

Pense em artistas, criadores de conteúdo, desenvolvedores de jogos… A barreira computacional para gerar conteúdo de alta qualidade vai diminuir drasticamente, liberando a criatividade de uma forma que a gente só imaginava em filmes de ficção científica. Imagens mais realistas, vídeos mais fluidos, e tudo isso em menos tempo e com menos recursos. É o futuro batendo na nossa porta, e ele é LINDO!

E você, o que achou dessa novidade? Consegue imaginar as possibilidades infinitas que os Latents Unificados da Google DeepMind vão trazer para o mundo da IA generativa? Deixa seu comentário aqui embaixo!

Referência: Matéria Original

Posts relacionados:

Cérebro enfrenta desafios diante da inteligência artificial, afirma neurocirurgião a Kalil

Cérebro enfrenta desafios diante da inteligência artificial, afirma neurocirurgião a Kalil

A IA superou o conhecimento humano, afirma unidade da DeepMind do Google.

A IA superou o conhecimento humano, afirma unidade da DeepMind do Google.

Amazono está oferecendo um MacBook Pro recondicionado por R$ 430, que já custou R$ 2.000 – veja o que inclui.

Amazono está oferecendo um MacBook Pro recondicionado por R$ 430, que já custou R$ 2.000 – veja o que inclui.

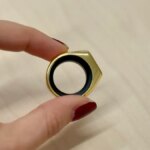

Experimentei um anel inteligente que registrou meus pensamentos e reproduziu minha voz – foi mais surpreendente do que eu imaginava.

Experimentei um anel inteligente que registrou meus pensamentos e reproduziu minha voz – foi mais surpreendente do que eu imaginava.