IBM acaba de lançar uma nova versão de sua família de modelos de linguagem grandes (LLMs), o Granite 3.2, que se dedica a oferecer soluções de inteligência artificial (IA) pequenas, eficientes e práticas para empresas.

A empresa tem feito atualizações em sua linha de LLMs Granite de forma rápida. A versão anterior, Granite 3.1, surgiu no final de 2024, sendo essencialmente uma atualização. No entanto, este novo modelo introduz capacidades experimentais de raciocínio em cadeia de pensamentos (CoT) em sua gama de funcionalidades.

O raciocínio CoT é uma técnica avançada de IA que permite aos LLMs desmembrar problemas complexos em passos lógicos, imitando, assim, processos de raciocínio humanos. Na teoria, essa abordagem melhora significativamente a capacidade de um LLM em lidar com tarefas que exigem raciocínio em múltiplas etapas, cálculos e tomadas de decisão. Em particular, o CoT da IBM utiliza uma estrutura de Otimização da Preferência de Pensamento que aprimora o raciocínio em uma ampla gama de tarefas de seguimento de instruções. Diferente das abordagens tradicionais de aprendizado por reforço que se concentram principalmente em tarefas guiadas por lógica, o TPO permite um desempenho de raciocínio melhorado sem comprometer a eficácia geral da tarefa. Essa metodologia ajuda a mitigar as trocas de desempenho comuns que são vistas em outros modelos que se especializam em raciocínio.

Mas, o que isso significa para nós? A IBM explicou que, ao pensar em dar um comando a um chatbot de IA, um processo chamado “encadeamento de comandos” resulta em uma resposta específica. Por exemplo, ao perguntar “Qual é a cor do céu?”, espera-se a resposta “Azul”. No entanto, se solicitado a explicar “Por que o céu é azul?” utilizando a sugestão de CoT, a IA primeiramente definiria o que significa “azul” (uma cor primária) e, em seguida, deduziria que o céu parece azul devido à absorção de outras cores pela atmosfera. Essa resposta demonstra a capacidade da IA de construir um argumento lógico, ou a impressão de que o LLM está raciocinando para chegar a uma resposta.

O CoT está disponível nas versões Granite 8B e 2B, permitindo que os desenvolvedores ativem ou desativem o raciocínio programaticamente. Essa funcionalidade possibilita que as empresas otimizem recursos computacionais com base na complexidade das tarefas. Afinal, às vezes, você só quer saber como está o céu, sem detalhes científicos. De acordo com a IBM, essa abordagem permite que o modelo 8B rivalize com o desempenho de modelos muito maiores, como Claude 3.5 Sonnet e GPT-4 em tarefas complexas de raciocínio matemático.

Além disso, a IBM lançou um novo Modelo de Linguagem de Visão (VLM) com dois bilhões de parâmetros, projetado especificamente para tarefas de compreensão de documentos. Este desenvolvimento não é, como você poderia pensar inicialmente, uma função gráfica. Em vez disso, o VLM visa melhorar as habilidades de compreensão documental do Granite. Utilizando sua ferramenta Docling de código aberto, a IBM processou 85 milhões de PDFs e gerou 26 milhões de pares de perguntas e respostas sintéticas para aprimorar a capacidade do VLM em lidar com fluxos de trabalho pesados em documentos.

Enquanto outras empresas de IA parecem evitar questões de segurança, a IBM continua a considerar a segurança uma prioridade. O Granite Guardian 3.2, o mais recente da suíte de modelos de segurança em IA da IBM, oferece detecção de riscos melhorada em comandos e respostas. Essa versão atualizada mantém o desempenho enquanto reduz o tamanho do modelo em 30%, introduzindo um novo recurso de “confiança verbalizada” para avaliações de risco mais nuançadas.

As empresas também podem se interessar pelas avançadas capacidades de previsão do Granite. Os novos modelos TinyTimeMixers (TTM), com menos de 10 milhões de parâmetros, podem realizar previsões de longo prazo de até dois anos. Esses modelos são úteis para análises de tendência em finanças, economia e gerenciamento de cadeia de suprimentos. Pode ser que ainda não ajudem você a montar sua equipe de beisebol dos sonhos, mas com o tempo, isso deverá mudar.

Como antes, a IBM é a empresa mais amigável ao código aberto no setor de IA. Todos os modelos Granite 3.2 estão disponíveis sob a licença Apache 2.0 na Hugging Face. Alguns modelos podem ser encontrados em plataformas como IBM WatsonX.ai, Ollama, Replicate e LM Studio. Essa abordagem aberta se alinha à estratégia da IBM de tornar a IA mais acessível e econômica para as empresas.

Como enfatizou o vice-presidente de pesquisa em IA da IBM: “A próxima era da IA se baseia em eficiência, integração e impacto no mundo real — onde as empresas podem alcançar resultados poderosos sem gastos excessivos com computação.”

Referência: https://www.zdnet.com/article/ibm-launches-granite-3-2-large-language-model/

Posts relacionados:

Como transformar o ChatGPT em sua ferramenta de programação poderosa e dobrar sua produtividade

Como transformar o ChatGPT em sua ferramenta de programação poderosa e dobrar sua produtividade

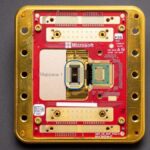

O chip quântico Majorana 1 da Microsoft ainda está a poucos qubits de completar sua meta

O chip quântico Majorana 1 da Microsoft ainda está a poucos qubits de completar sua meta

Tencent afirma que sua nova IA supera em velocidade o modelo R1 da DeepSeek.

Tencent afirma que sua nova IA supera em velocidade o modelo R1 da DeepSeek.

5 ajustes simples no Gemini para proteger sua privacidade em relação à IA

5 ajustes simples no Gemini para proteger sua privacidade em relação à IA