Microsoft Surpreende com IA Compacta e Multimodal: O Que o Phi-4-reasoning-vision-15B Pode Fazer Pela Sua Vida Digital?

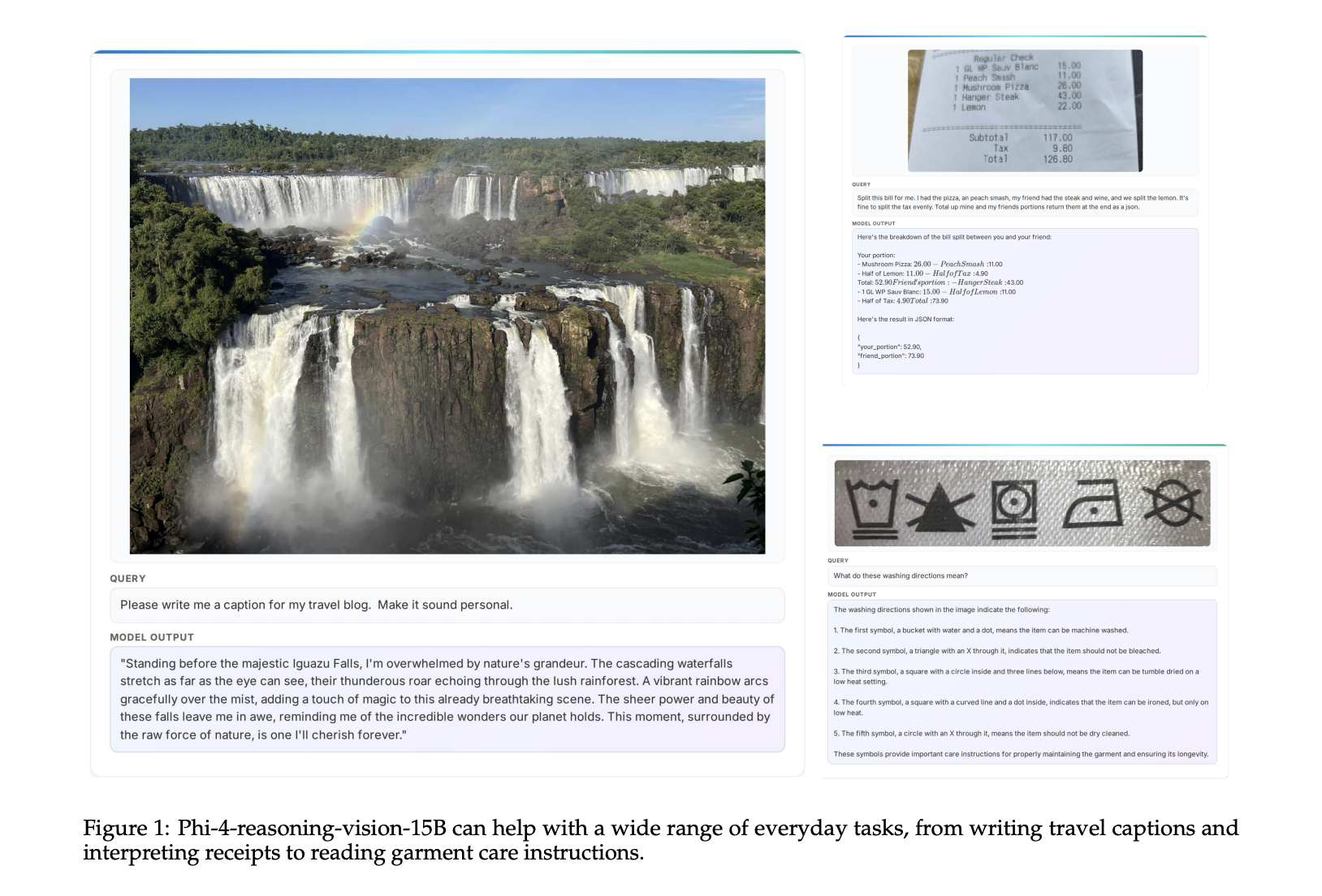

Olá, pessoal! Aqui é o Lucas Tech, e hoje tenho uma notícia que vai fazer a cabeça de vocês borbulhar! A Microsoft, sempre na vanguarda, acaba de soltar uma novidade que promete ser um divisor de águas no mundo da inteligência artificial: o Phi-4-reasoning-vision-15B. Sim, o nome é comprido, mas a ideia por trás dele é genial e, preparem-se, compacta!

Imagine uma IA que não só entende o que você digita, mas também vê e interpreta imagens com uma clareza impressionante, focando no que realmente importa. É exatamente isso que a Microsoft nos entrega com este modelo de 15 bilhões de parâmetros. Ele é um monstrinho (no bom sentido!) de raciocínio multimodal de peso aberto, feito para lidar com tarefas que misturam texto e imagem, exigindo percepção e um raciocínio seletivo afiado. E o melhor? É um modelo mais leve, que busca o equilíbrio perfeito entre qualidade de raciocínio, eficiência computacional e os requisitos de dados para treinamento. Preparem-se para ver onde ele brilha de verdade!

O Coração do Phi-4: Como Ele É Construído?

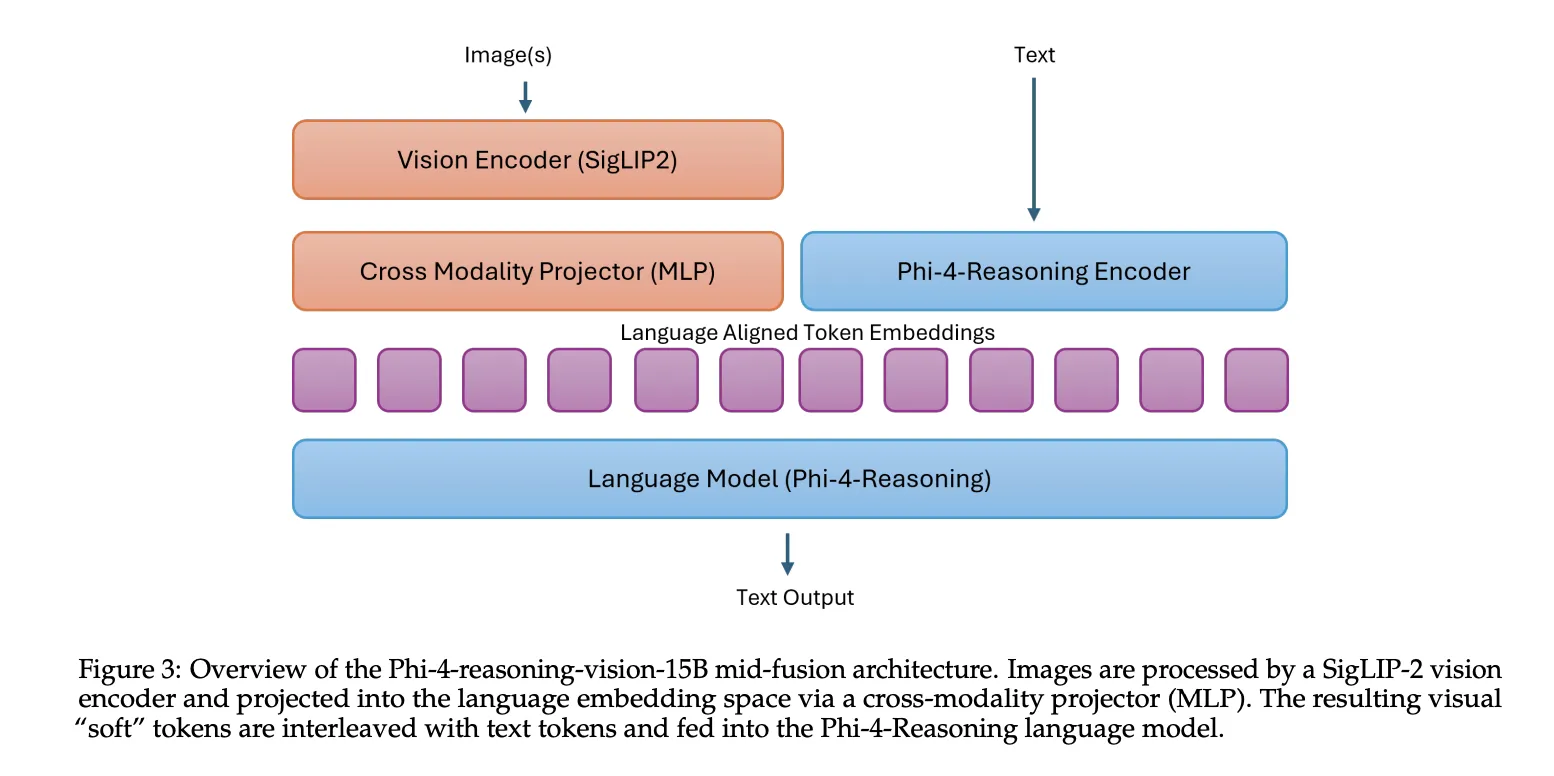

Pra entender a mágica do Phi-4-reasoning-vision-15B, a gente precisa olhar um pouco para a sua "anatomia". Ele é uma combinação inteligente da espinha dorsal de linguagem Phi-4-Reasoning com o codificador de visão SigLIP-2, tudo isso conectado por uma arquitetura de média fusão.

Mas o que isso significa na prática? Basicamente, o codificador de visão pega as imagens e as transforma em "tokens visuais" (pequenos pedaços de informação). Depois, esses tokens são projetados para o espaço de embedding do modelo de linguagem e processados por ele. É um design super esperto que consegue manter um raciocínio cross-modal (entre texto e imagem) bem forte, sem explodir os custos de treinamento e inferência, como acontece com arquiteturas mais pesadas. É o famoso "ótimo custo-benefício" no mundo da IA!

Por Que Menor Pode Ser Melhor? A Estratégia da Microsoft!

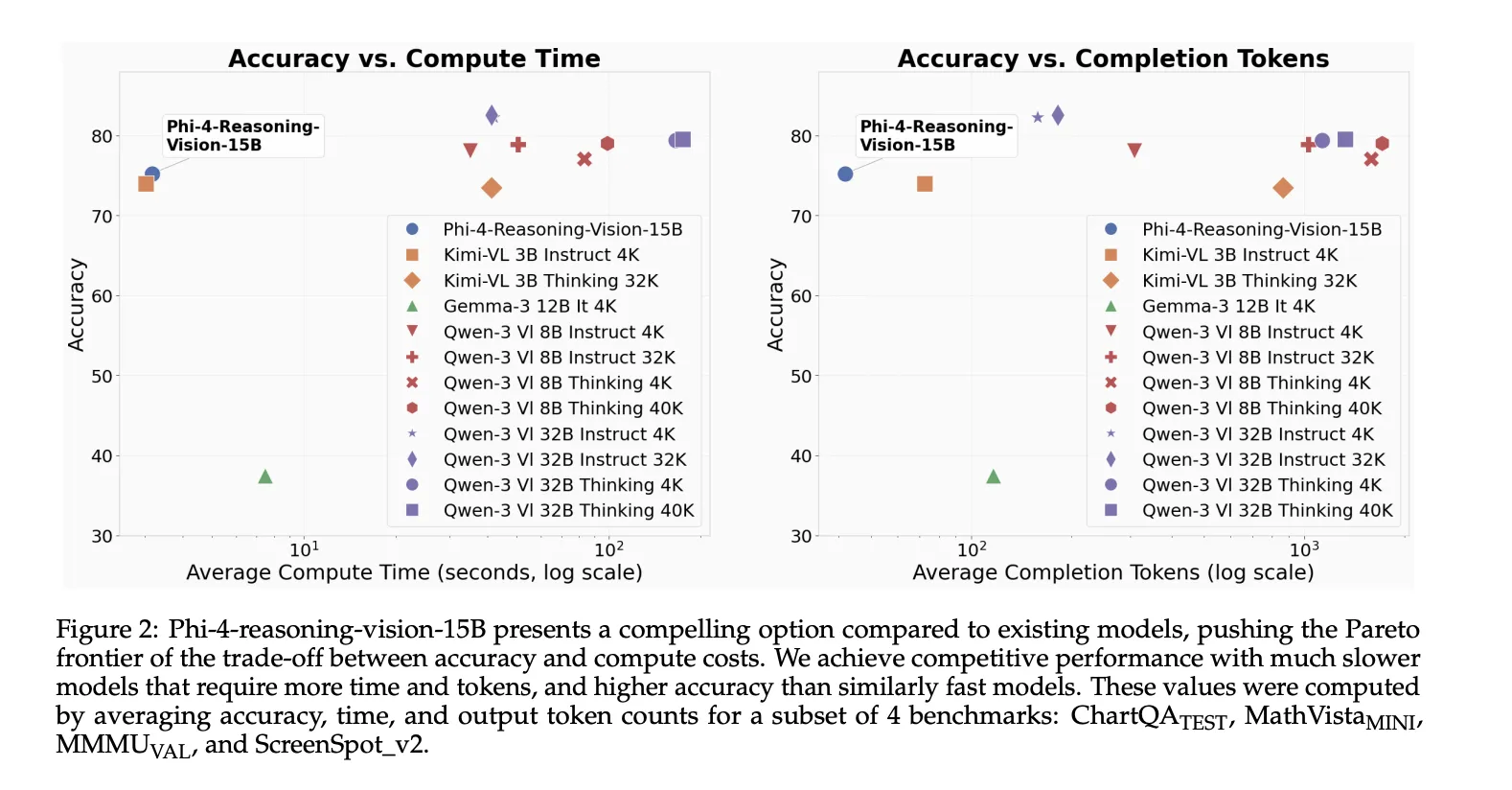

Em um mundo onde os modelos de IA estão crescendo em tamanho a cada dia, a Microsoft fez uma escolha ousada com o Phi-4-reasoning-vision-15B. Enquanto muitos modelos recentes aumentam a contagem de parâmetros e o uso de tokens, o que acaba gerando mais latência e custos de implantação mais altos, a Microsoft seguiu um caminho diferente.

Eles criaram o Phi-4 como uma alternativa menor, mas que ainda assim consegue dar conta de cargas de trabalho multimodais comuns sem depender de datasets gigantescos ou de uma geração excessiva de tokens durante a inferência. Para vocês terem uma ideia, este modelo foi treinado com 200 bilhões de tokens multimodais. Isso é muito, claro, mas comparem com os mais de 1 trilhão de tokens usados para treinar modelos como Qwen 2.5 VL, Qwen 3 VL, Kimi-VL e Gemma 3! É uma diferença e tanto, mostrando que é possível fazer muito com menos!

Visão de Águia: A Percepção de Alta Resolução Faz a Diferença!

Aqui está um dos pontos mais cruciais que a equipe da Microsoft aprendeu: muitas vezes, o raciocínio multimodal falha porque a percepção falha primeiro. É como se a IA não conseguisse enxergar direito os detalhes. Ela pode errar a resposta não por falta de capacidade de raciocínio, mas porque não conseguiu extrair as informações visuais relevantes de imagens complexas, como capturas de tela, documentos densos ou interfaces com elementos muito pequenos.

Pensando nisso, o Phi-4-reasoning-vision-15B usa um codificador de visão de resolução dinâmica com até 3.600 tokens visuais. Isso significa que ele é feito para ter um entendimento de alta resolução, ideal para tarefas como a ancoragem de GUIs (entender onde cada elemento de uma interface está) e análise detalhada de documentos. A Microsoft é categórica: codificadores de alta resolução e resolução dinâmica trazem melhorias consistentes, e uma percepção precisa é pré-requisito para um raciocínio de qualidade. É o famoso "ver para crer" levado a sério!

Pensar ou Não Pensar? A Estratégia Híbrida de Raciocínio!

Outra sacada genial no design do Phi-4 é sua estratégia mista de treinamento, que envolve raciocínio e não raciocínio. Em vez de forçar um raciocínio estilo "cadeia de pensamento" para todas as tarefas, a equipe da Microsoft treinou o modelo para alternar entre dois modos.

- Modo Raciocínio: Para tarefas que exigem um pensamento mais complexo (tipo resolver problemas de matemática ou ciência), o modelo usa "traços" como

<think>...</think>. - Modo Não Raciocínio: Para tarefas mais focadas na percepção, como gerar legendas para imagens, ancorar elementos visuais, fazer OCR (Reconhecimento Óptico de Caracteres) ou responder a perguntas visuais simples (VQA), ele começa com

<nothink/>.

O raciocínio representa cerca de 20% do treinamento. O objetivo dessa configuração híbrida é permitir que o modelo responda diretamente quando um raciocínio mais longo adicionaria latência sem melhorar a precisão, mas ainda assim invocar um raciocínio estruturado quando necessário. É a inteligência de saber a hora certa de pensar!

Onde o Phi-4-reasoning-vision-15B Brilha Mais?

A Microsoft destaca duas áreas principais onde o Phi-4 se sobressai:

- Raciocínio Científico e Matemático com Entradas Visuais: Isso inclui equações escritas à mão, diagramas, gráficos, tabelas e documentos quantitativos. Imagina a ajuda para estudantes, cientistas e engenheiros!

- Tarefas de Agente de Uso de Computador: Aqui, o modelo é capaz de interpretar o conteúdo da tela, localizar elementos de interface gráfica (GUIs) e auxiliar na interação com interfaces de desktop, web ou mobile. Pensem em automação inteligente e assistentes virtuais muito mais capazes!

Resultados Que Impressionam (e Surpreendem)!

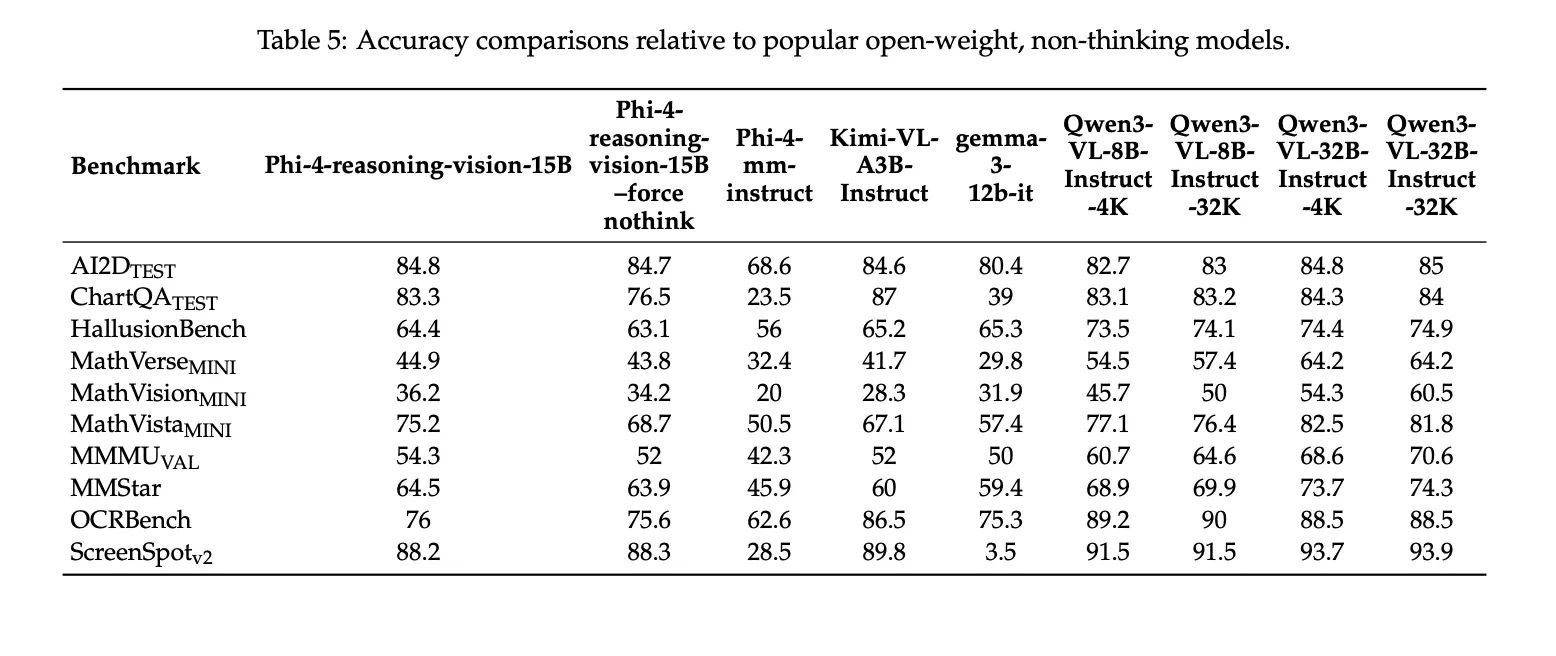

Mesmo sendo um modelo "compacto", o Phi-4-reasoning-vision-15B mostra números impressionantes em diversos benchmarks:

- AI2DTEST: 84.8

- ChartQATEST: 83.3

- MathVerseMINI: 44.9

- MathVisionMINI: 36.2

- MathVistaMINI: 75.2

- MMMUVAL: 54.3

- MMStar: 64.5

- OCRBench: 76.0

- ScreenSpotv2: 88.2

É importante notar que a equipe da Microsoft gerou esses resultados usando ferramentas específicas (Eureka ML Insights e VLMEvalKit) e os apresenta como comparações, e não como reivindicações de liderança absoluta em leaderboards. Mas, ainda assim, são resultados muito promissores para um modelo do seu tamanho!

Minha Visão

Olha, pessoal, pra mim, o Phi-4-reasoning-vision-15B da Microsoft não é só mais um modelo de IA. Ele representa uma mudança de paradigma super importante. Enquanto a maioria das grandes empresas corre atrás de modelos gigantescos que consomem rios de recursos e exigem infraestruturas caríssimas, a Microsoft mostra que é possível ter alta performance com muito mais eficiência.

Isso significa que podemos ter IAs mais inteligentes, mais rápidas e, principalmente, mais acessíveis, rodando em mais lugares – talvez até em dispositivos que hoje parecem improváveis. É um passo enorme para democratizar a IA e trazer essas capacidades de raciocínio avançado para um público muito maior, desde cientistas a desenvolvedores de aplicativos, sem a barreira dos custos altíssimos. A eficiência e a inteligência focalizada são as chaves aqui, e a Microsoft acertou em cheio!

E vocês, o que acham dessa abordagem da Microsoft? Acreditam que modelos mais compactos e eficientes são o futuro da IA, ou o tamanho ainda é documento? Deixem seus comentários e vamos bater um papo sobre isso!

Referência: Matéria Original

Posts relacionados:

Sua marca é um gênio? A IA da Microsoft revela o segredo.

Sua marca é um gênio? A IA da Microsoft revela o segredo.

TV gigante de 136 polegadas da Hisense pode não caber na sua casa, mas você pode adquiri-la com R$ 20.000 de desconto.

TV gigante de 136 polegadas da Hisense pode não caber na sua casa, mas você pode adquiri-la com R$ 20.000 de desconto.

Adoro o mais recente gerador de imagens por IA, mas há uma pequena ressalva.

Adoro o mais recente gerador de imagens por IA, mas há uma pequena ressalva.

Por que uma pequena caixa chamada Comet pode ser a solução para a frustração com servidores headless.

Por que uma pequena caixa chamada Comet pode ser a solução para a frustração com servidores headless.