O Segredo dos Data Centers de IA: Por Que Você Precisa Parar de Olhar para o FLOPS AGORA!

Olá, pessoal! Aqui é o Lucas Tech, e hoje a gente vai mergulhar em um assunto que está borbulhando no mundo da inteligência artificial e que pode mudar completamente a forma como você enxerga a infraestrutura de TI. Já parou pra pensar como a IA generativa e os agentes inteligentes transformaram os nossos bons e velhos data centers? Pois é, eles deixaram de ser meros "guardiões de dados" e viraram algo muito mais fascinante e… lucrativo! Prepare-se, porque a forma de avaliar o "custo" da IA mudou, e se você ainda está preso às métricas antigas, pode estar perdendo muito dinheiro!

De Armazéns a Fábricas de Inteligência: A Nova Era dos Data Centers

Sabe aqueles data centers gigantes que a gente conhecia? Aqueles que guardavam, buscavam e processavam dados? Pois é, no mundo da IA generativa e dos agentes inteligentes, eles viraram… adivinha só? ‘Fábricas de Tokens de IA’! Isso mesmo! A principal função agora é ‘fabricar’ inteligência, e essa inteligência vem na forma de tokens.

Pense assim: a inferência de IA, que é basicamente fazer a inteligência artificial pensar e gerar respostas, se tornou a principal carga de trabalho. E o produto final? É inteligência fabricada na forma desses tokens.

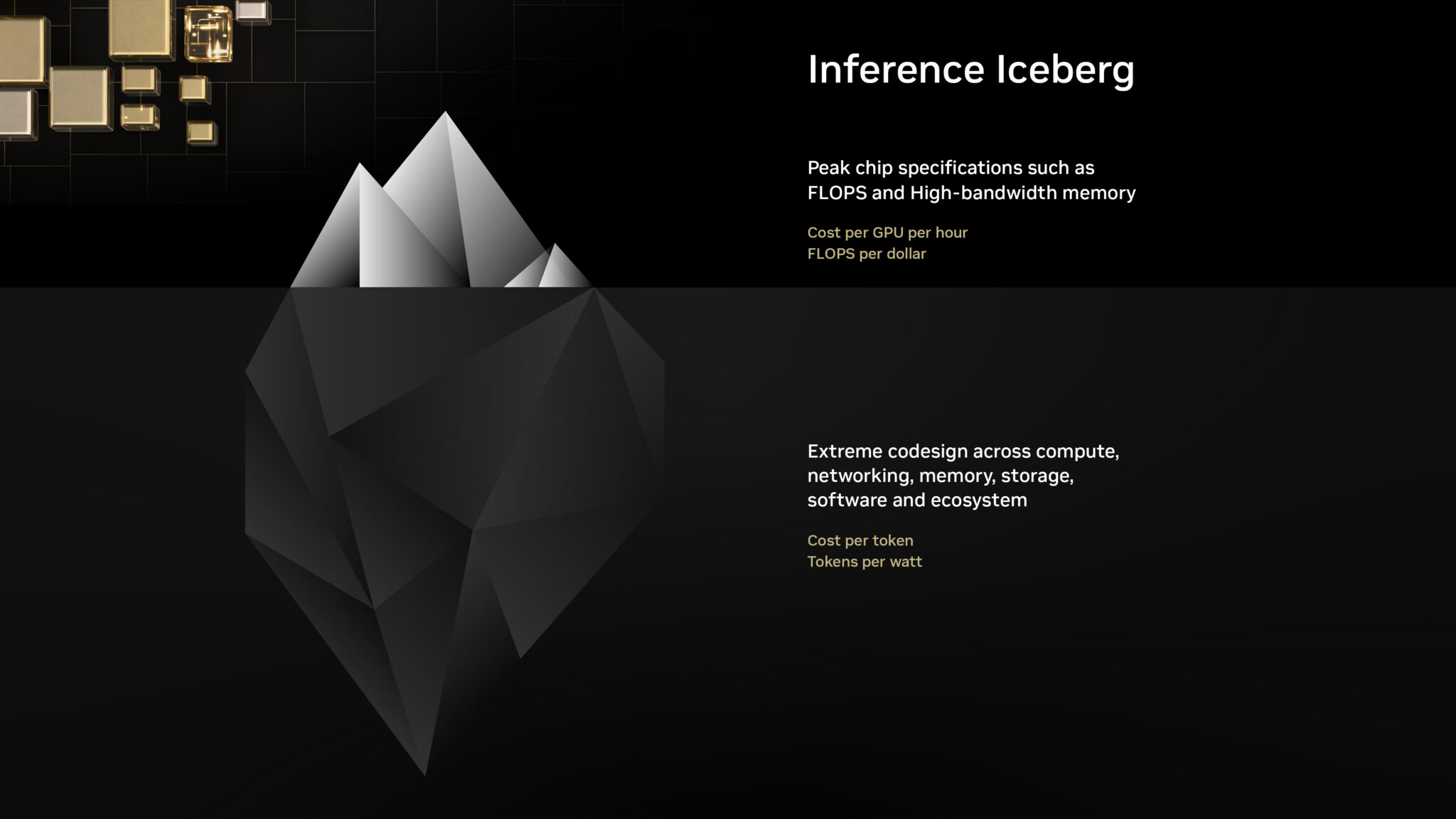

E essa transformação exige uma mudança GIGANTE na forma como a gente calcula a economia da infraestrutura de IA, incluindo o famoso Custo Total de Propriedade (TCO). Muita gente ainda fica presa olhando para especificações de chips, custo de computação ou o tal do FLOPS por dólar (FLOPS/dólar). Mas ó, essa visão está incompleta!

Desvendando as Métricas da IA: Custo por Token é o Novo Ouro!

Vamos descomplicar algumas métricas que você precisa conhecer:

- Custo de Computação: É simplesmente o que as empresas pagam pela infraestrutura de IA, seja alugando serviços de provedores de nuvem ou tendo tudo ‘em casa’ (on-premises). É o valor da "plataforma" em si.

- FLOPS por Dólar: Essa métrica te diz quanta capacidade bruta de processamento (FLOPS) você consegue por cada dólar investido. Parece bom à primeira vista, né? Mas poder bruto e a quantidade real de tokens que você produz no mundo real são coisas BEM diferentes!

- Custo por Token: Ah, aqui está o ouro! Essa é a métrica mais importante: o custo total para produzir CADA token entregue pela sua IA, geralmente representado como custo por milhão de tokens.

Focar nas duas primeiras é tipo otimizar a gasolina, mas esquecer quanto o carro realmente anda por litro. Não faz sentido se o seu negócio depende do que sai lá da sua IA, não é? Otimizar as "entradas" enquanto o seu negócio roda nas "saídas" é um descompasso fundamental!

É o custo por token que define se a sua IA vai escalar e, o mais importante, ser lucrativa! É a única métrica de TCO que leva em conta TUDO: desempenho do hardware, otimização de software, suporte do ecossistema e, claro, a utilização no mundo real. E, spoiler: a NVIDIA está detonando nesse quesito, entregando o menor custo por token do mercado.

O Que Faz o Custo por Token Cair? A Equação Mágica!

Para entender como otimizar o custo por token, precisamos olhar para a equação:

![An equation describing how to calculate cost per million tokens. Cost per million tokens = [cost per GPU per hour / (tokens per GPU per second x 60 seconds x 60 minutes) ] x 1 million.](https://bitsgeniais.com.br/wp-content/uploads/2026/04/inference-equation-token-5115300-scaled.png)

Muitas empresas que avaliam a infraestrutura de IA ficam de olho apenas no numerador: o custo por GPU por hora. Mas o SEGREDO de verdade para reduzir o custo por token está no denominador: maximizar a produção de tokens entregues!

Isso tem duas implicações de negócio super importantes:

- Minimizar o custo por token: Quando você aumenta a produção de tokens, essa otimização se reflete na equação, derrubando o custo por token e aumentando sua margem de lucro em cada interação de IA. É a sua IA ficando mais barata e eficiente!

- Maximizar a receita: Mais tokens por segundo significa mais tokens por megawatt (ou seja, mais inteligência usando a mesma energia!). Isso se traduz em mais inteligência para seus produtos e serviços, gerando mais receita com o MESMO investimento em infraestrutura.

Então, focar só no numerador é como ver apenas a ponta de um iceberg. O numerador está lá, visível, fácil de comparar. Mas o denominador? Ah, esse é todo o resto, o gigantesco bloco de gelo submerso que representa os fatores chave que realmente determinam a produção de tokens no mundo real. Avaliar a infraestrutura de IA de forma precisa começa por perguntar: o que está escondido lá embaixo?

Olha só algumas das perguntas que a gente tem que fazer:

Na superfície (a pontinha do iceberg):

- Qual o custo por hora da GPU?

- Quantos petaflops de pico e memória de alta largura de banda (HBM) eu tenho?

- Qual é o FLOPS por dólar?

- Na análise de custo aprofundada (o gigante submerso):

- Qual é o custo por milhão de tokens? Principalmente para modelos complexos como os Mixture-of-Experts (MoE), que são super populares hoje em dia?

- Qual é a saída de tokens entregues por megawatt? Para data centers próprios, otimizar a inteligência produzida por megawatt é crucial!

- A interconexão interna consegue lidar com o tráfego "all-to-all" dos modelos MoE? Isso é vital para a comunicação entre as GPUs!

- A precisão FP4 é suportada? E o software de inferência consegue usar FP4 mantendo a alta precisão?

- O runtime de inferência suporta decodificação especulativa ou predição multi-token para tornar a interação do usuário mais rápida e fluida?

- A camada de serviço (serving layer) suporta serviço desagregado, roteamento ciente do KV-cache, descarregamento de KV-cache e outras otimizações?

- A plataforma atende aos requisitos únicos da IA com agentes (Agentic AI) — como latência ultra baixa, alto throughput e grandes comprimentos de sequência de entrada?

- A plataforma suporta o ciclo de vida completo da IA, do treinamento à inferência em larga escala, em todas as arquiteturas de modelo, garantindo que o investimento seja flexível e bem utilizado?

Cada uma dessas otimizações (algorítmicas, de hardware e software) precisa estar ativa e integrada. Se não, o denominador desmorona! Uma GPU "mais barata" que entrega significativamente menos tokens por segundo no final das contas resulta em um custo por token MUITO mais alto. Uma infraestrutura de IA que acerta em tudo, do hardware ao software, garante que cada otimização impulsione as outras. É um efeito cascata positivo!

Por Que o Custo por Token DERRUBA o FLOPS por Dólar? A Prova da NVIDIA Blackwell!

Vou te mostrar um exemplo real com o modelo de IA DeepSeek-R1, comparando as plataformas NVIDIA Hopper e NVIDIA Blackwell. Prepare-se, porque a diferença é chocante:

| Métrica | NVIDIA Hopper (HGX H200) | NVIDIA Blackwell (GB300 NVL72) | Blackwell vs. Hopper |

|---|---|---|---|

| Custo por GPU por Hora ($) | $1.41 | $2.65 | 2x |

| FLOPS por Dólar (PFLOPS) | 2.8 | 5.6 | 2x |

| Tokens de Saída por GPU | 90 | 6K | 65x |

| Tokens de Saída por MW | 54K | 2.8M | 50x |

| Custo por Milhão de Tokens ($) | $4.20 | $0.12 | 35x menor |

(Dados da NVIDIA e do benchmark SemiAnalysis InferenceX v2)

Se você olhasse só para o custo da GPU, a Blackwell parece ser umas 2x mais cara que a Hopper. Olhando para o FLOPS por dólar, a Blackwell ainda tem uma vantagem de 2x. Mas olha o resultado REAL: a Blackwell entrega 50x mais tokens por watt que a Hopper, o que resulta em um custo por milhão de tokens quase 35x menor!

Essa diferença gigantesca mostra que a NVIDIA Blackwell não é só um ‘upgrade’, é um SALTO quântico no valor de negócio que você recebe, muito além de qualquer aumento no custo do sistema. É economia na veia!

Escolhendo a Infraestrutura de IA Certa: Menos Achismo, Mais Estratégia!

Comparar a infraestrutura de IA com base apenas no custo de computação ou nos FLOPS por dólar teóricos não é só insuficiente; é uma armadilha que não te dá a representação precisa da economia da inferência. Como os dados mostram, para avaliar de verdade o potencial de receita e a lucratividade da sua IA, você precisa mudar o foco das métricas de "entrada" para o custo por token e a produção de tokens entregues.

A NVIDIA, com seu codesign extremo (integrando computação, rede, memória, armazenamento, software e tecnologias de parceiros), entrega o menor custo por token e a maior capacidade de tokens do setor. E não para por aí: a otimização constante de softwares de inferência open source (como vLLM, SGLang, NVIDIA TensorRT-LLM e NVIDIA Dynamo) na plataforma NVIDIA significa que, mesmo na infraestrutura NVIDIA que você já tem, a produção de tokens continua aumentando e o custo por token continua caindo muito depois da aquisição. É investimento que se valoriza!

E as boas notícias? Provedores de nuvem líderes e parceiros da NVIDIA, como CoreWeave, Nebius, Nscale e Together AI, já estão implantando a infraestrutura NVIDIA Blackwell e otimizando suas stacks para oferecer às empresas o menor custo por token disponível hoje, com todo o benefício do hardware, software e ecossistema NVIDIA por trás de cada interação de IA.

Minha Visão

Pra mim, como entusiasta de tecnologia, essa mudança é um divisor de águas. Não estamos mais falando apenas de chips poderosos ou de benchmarks impressionantes. Estamos falando de como a IA se torna sustentável e acessível para as empresas. É a diferença entre ter um protótipo legal e construir um negócio que realmente gera valor e escala. Ver empresas focando na eficiência real, na entrega de "inteligência" por um custo otimizado, me mostra que a IA está amadurecendo e se tornando uma ferramenta estratégica fundamental, não um brinquedo caro para poucos. É a inteligência artificial saindo do laboratório e realmente mudando a economia do mundo real!

E você, já tinha parado para pensar no custo real da inteligência que a sua empresa ou projeto de IA está produzindo? Qual métrica você vai começar a priorizar agora? Me conta nos comentários!

Referência: Matéria Original

Posts relacionados:

THINKING PROCESS:

Analyze the original title: "I just played Crimson Desert on PS5 Pro — here’s how this massive RPG looks and runs on console"

- Core subject: Crimson Desert

- Platform: PS5 Pro (and "console" in general)

- Main aspects discussed: Looks (graphics), runs (performance)

- Implied tone: Personal experience, informative review/first impression.

- Keywords: Crimson Desert, PS5 Pro, RPG, looks, runs, console.

Understand the target platform: Google Discover.

- Characteristics: Visual-driven, snackable content, engaging, curiosity-inducing, often uses questions, bold claims, or intriguing statements. Personalization is key.

- Goal: Make people click now.

Understand the requirements:

- Language: Portuguese (BR, implied).

- Length: Short.

- Tone: Curious.

- Output: ONLY the final title text.

Brainstorm Portuguese equivalents for key concepts:

- "I just played" -> Joguei, Acabei de jogar, Minha experiência com

- "Crimson Desert" -> Crimson Desert (keep original)

- "PS5 Pro" -> PS5 Pro (keep original)

- "massive RPG" -> RPG massivo, RPG gigante, mundo aberto gigante

- "looks and runs" -> Gráficos e desempenho, Como roda, Como está, O que esperar

- "on console" -> No console, No PS5 Pro

Focus on "short and curious" for Google Discover:

Curiosity triggers:

- Questions (e.g., "Impressionado?", "Como será?", "Vale a pena?")

- Intriguing statements (e.g., "Você não vai acreditar!", "Chocante!", "Surpreendente!")

- Direct address ("Você precisa ver")

- Highlighting the impressiveness or challenge of the game/platform.

- Using strong adjectives (massivo, gigante, surpreendente, incrível).

- Shortness: Avoid long clauses, get straight to the point.

Drafting – Iteration 1 (Mental or scratchpad):

- "Joguei Crimson Desert no PS5 Pro: veja como roda!" (Too plain)

- "Crimson Desert no PS5 Pro: gráficos e desempenho surpreendem?" (Better, but maybe more active)

- "Como Crimson Desert roda no PS5 Pro? É gigante!" (A bit clunky)

- "O RPG massivo Crimson Desert no PS5 Pro: veja como ele se saiu!" (A bit long)

Focus on the "massive RPG" aspect combined with "PS5 Pro":

- The challenge for an "RPG massivo" to run well on a console is the implicit hook. The PS5 Pro is the specific new tech.

Drafting – Iteration 2 (Closer to final):

- "Crimson Desert no PS5 Pro: o RPG massivo surpreende no console?" (Good, but "surpreende" might be too weak, or implies it might not surprise).

- "Crimson Desert no PS5 Pro: É assim que o RPG massivo roda!" (A bit bland).

- "Joguei Crimson Desert no PS5 Pro: o RPG massivo impressiona!" (Good, but "joguei" might make it sound too personal, not for a broader audience seeking a quick info bite). Discover often uses more declarative or question-based styles.

Refine for "curious" and "short":

What makes people curious about a huge game on a powerful console?

- Does it push the limits?

- Is it smooth?

- Are the graphics mind-blowing?

Combine game, platform, and key performance aspects.

- Option 1 (Question-based): "Crimson Desert no PS5 Pro: O RPG massivo impressiona?" (Good, short, curious. "Impressiona" covers both looks and runs implicitly).

- Option 2 (Statement-based with intrigue): "Crimson Desert no PS5 Pro: O RPG gigante em ação!" (A bit less specific on performance).

- Option 3 (Focus on the how): "Crimson Desert no PS5 Pro: Veja como o RPG massivo se saiu!" (A bit long, "se saiu" is okay but not super punchy).

Final selection strategy:

- Choose the one that best combines "Crimson Desert," "PS5 Pro," "massive RPG," and the core idea of "looks and runs" in a curious and short way.

- The question format is excellent for Discover.

"Impressiona" in Portuguese is a strong verb that covers both visual appeal and performance satisfaction.

- Consider: "Crimson Desert no PS5 Pro: como o RPG massivo roda?" (Good, direct, but maybe a bit too much "como roda" which is expected.)

- Consider: "Crimson Desert no PS5 Pro: gráficos e desempenho no RPG gigante!" (A bit descriptive, less curious).

Consider: "Crimson Desert no PS5 Pro: O RPG massivo te surpreende?" (Very good, direct to the reader).

- Let’s try one more: "Crimson Desert no PS5 Pro: O RPG massivo te convence?" (A bit strong on "convence" – implies skepticism).

"Crimson Desert no PS5 Pro: Vale a pena?" (Too generic).

Let’s go back to focusing on the impact of the game running on the Pro. "Impressiona" is good because it covers both visual fidelity and smooth performance, and it directly asks if the combination delivers.

- "Crimson Desert no PS5 Pro: o RPG massivo impressiona?"

- Short: Yes.

- Curious: Yes, it asks a direct question that makes the reader wonder about the answer.

- Covers key elements: Game title, platform, genre, and the core "how it performs" implied by "impressiona."

- Final check: Is it only the title text? Yes.

The chosen title is concise, uses the game and console names, highlights its genre ("RPG massivo") as a key challenge/feature, and asks a direct question ("impressiona?") to pique curiosity about its performance and visuals.

"Crimson Desert no PS5 Pro: O RPG massivo impressiona?"Crimson Desert no PS5 Pro: O RPG massivo impressiona?

THINK: The user wants me to rewrite a long, technical English title into a short, curious Portuguese title suitable for Google Discover. I need to focus on the "autonomous machine learning research loop" and "hyperparameter discovery" aspects, making it sound intriguing without being overly complex. I must only return the final title.

Analyze the original title:

- "How to Build an Autonomous Machine Learning Research Loop in Google Colab Using Andrej Karpathy’s AutoResearch Framework for Hyperparameter Discovery and Experiment Tracking"

- Core idea 1: Autonomous ML Research Loop

- Core idea 2: Hyperparameter Discovery / Experiment Tracking

- Tool: Google Colab

- Framework: Andrej Karpathy’s AutoResearch Framework (this is too specific/long for Discover)

Identify key concepts for curiosity:

- "Autonomous" -> automatizado, sozinho, sem você

- "Research Loop" -> pesquisa, descoberta, otimização

- "Machine Learning" -> IA, aprendizado de máquina

- "Hyperparameter Discovery" -> melhores resultados, segredos, IA que se aprimora

- "Google Colab" -> fácil, acessível

Brainstorm short, curious Portuguese phrases:

- "Sua IA faz pesquisa sozinha?" (Too informal/simplistic)

- "Colab: sua IA descobre os segredos sozinha."

- "Máquina que aprende sozinha: o loop de pesquisa."

- "Automação ML: deixe a IA otimizar tudo."

- "Descoberta de hiperparâmetros: a IA faz por você."

- "Colab: IA autônoma em pesquisa."

- "Sua IA pesquisa e se aprimora sozinha."

- "Colab: Sua IA pesquisa e se aprimora SOZINHA?"

Refine for Discover style (short, curious, engaging):

- Needs to hint at the "loop" and "discovery" without being explicit about the technical terms.

- "Autonomous" is strong. "Máquina que aprende sozinha" is good.

- "Colab" is a recognizable platform.

- Focus on the benefit: better results, faster discovery, less manual work.

Draft options and evaluate:

- Option 1: "Sua IA pesquisa e se aprimora sozinha no Colab?" (Good, curious, short, uses "sozinha" for autonomous and "aprimora" for hyperparameter discovery/experiment tracking implicitly).

- Option 2: "Colab: Deixe sua IA descobrir os melhores parâmetros." (A bit less about the "loop" and "research," more specific to parameters).

- Option 3: "Máquina que aprende sozinha: o segredo no Colab." (Intriguing, but "segredo" might be too vague).

- Option 4: "Crie uma IA que pesquisa sozinha no Google Colab." (Good, but "crie" might imply building the AI, not just the loop).

- Option 5: "Colab: Sua IA já otimiza os próprios resultados?" (Good, focuses on optimization and "próprios" implies autonomous).

Select the best fit: Option 1 or 5 are strong. Option 1 "Sua IA pesquisa e se aprimora sozinha no Colab?" directly addresses the "research loop" (pesquisa) and "hyperparameter discovery/experiment tracking" (aprimora), while keeping it curious and short. "Sozinha" captures "autonomous." It’s also a question, which is good for Discover engagement.

Let’s try to make it even more punchy, maybe less of a question. "Colab: Sua IA Otimiza Sozinha?" (Too short, loses "research") "Colab: A IA Que Pesquisa e Se Aprimora SOZINHA" (Strong, emphasizes "sozinha") "Descubra: Sua IA Pesquisa E Otimiza Sozinha?" (Adds "Descubra" for curiosity) "Colab: Sua IA já se aprimora sozinha?" (Good, concise, highlights the autonomous self-improvement)

Let’s go with a direct, intriguing question that hints at the core functionality. The "loop" implies continuous research and improvement.

"Sua IA Pesquisa e Otimiza SOZINHA no Colab?" This captures:

- "Pesquisa" (Research loop)

- "Otimiza" (Hyperparameter discovery, experiment tracking, improvement)

- "SOZINHA" (Autonomous)

- "Colab" (Platform)

- It’s a question, making it curious.

- It’s short.

I think "Sua IA Pesquisa e Otimiza SOZINHA no Colab?" is a very good fit. It’s direct, curious, and covers the main points succinctly.

Let’s try one more: "Colab: Sua IA Já Otimiza os Próprios Experimentos?" This is also good, "otimiza os próprios experimentos" maps well to the hyperparameter discovery and experiment tracking loop. "Próprios" implies autonomous.

I will go with something that highlights the "alone/autonomous" aspect clearly, and the "improvement" or "research" part.

"Colab: Sua IA pesquisa e se aprimora SOZINHA?" – This uses "pesquisa" (research) and "aprimora" (improves/optimizes) and "sozinha" (autonomous) and "Colab". It’s a question, short, and curious. This feels like a strong contender.Colab: Sua IA pesquisa e se aprimora SOZINHA?

Construa seu site rapidamente com o novo criador de sites por inteligência artificial – e sem custo algum.

Construa seu site rapidamente com o novo criador de sites por inteligência artificial – e sem custo algum.

Por que este carregador de viagem se tornou essencial na minha mochila, especialmente pelo custo-benefício

Por que este carregador de viagem se tornou essencial na minha mochila, especialmente pelo custo-benefício